Künstliche Neuronale Netze

Im dritten Teil der TUP-Vorstellungsreihe zu Künstlicher Intelligenz (KI) beschäftigen wir uns mit einem für die KI unerlässlichen Thema: Künstliche Neuronale Netze (KNN). Mithilfe von KNN konnten in den vergangen Jahren große Fortschritte beim Maschinellen Lernen (ML) erreicht werden. Kein anderes Feld hat die Forschung hier so schnell und so weit vorangebracht. Von der Bildverarbeitung über Spracherkennung bis hin zur medizinischen Diagnostik prägen KNN die moderne Welt.

Dabei gehören KNN zu den ältesten Forschungsgebieten im Umfeld der KI. Heute sind sie Forschungsgegenstand der Neuroinformatik, doch bereits in den 1940er-Jahren, also mit dem Aufkommen der ersten Computer, entstanden die grundlegenden Theorien und Anwendungsfälle im Bereich der angewandten Mathematik. Viele der damaligen Erkenntnisse haben auch heute noch Bestand, wie beispielsweise die Hebbsche Lernregel. Doch erst das Aufkommen leistungsfähiger Rechner und die damit verbundene Möglichkeit große Datenmengen zu verarbeiten, haben den KNN zu ihrem Siegeszug in unserer Gesellschaft verholfen. Seit einigen Jahren geistert der Begriff nun schon durch die Publikums- und Fachmedien weltweit. Doch was genau steckt dahinter?

Natur als Vorbild: So funktionieren künstliche neuronale Netze

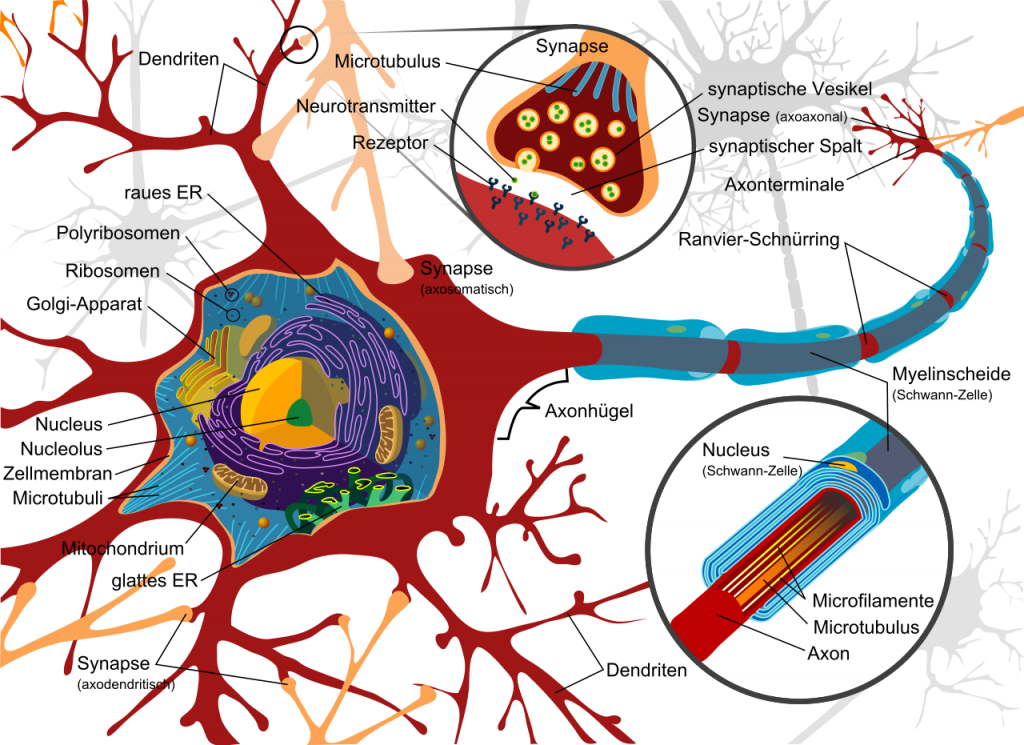

Wie schon angedeutet sind KNN ein wesentlicher Teilaspekt von KI, denn sie ermöglichen das sogenannte Maschinelle Lernen. Der Begriff selbst leitet sich dabei aus einer biologischen Analogie ab. KNN sind den in der Natur vorkommenden neuronalen Netzen nachempfunden, wie sie in den Gehirnen vieler Lebewesen vorkommen. Alleine im menschlichen Gehirn soll es etwa 86 Milliarden einzelne Neuronen geben, die miteinander verbunden sind. Die daraus entstehenden neuronalen Netze bilden die Grundlage für die Verarbeitung von Signalen im menschlichen Körper.

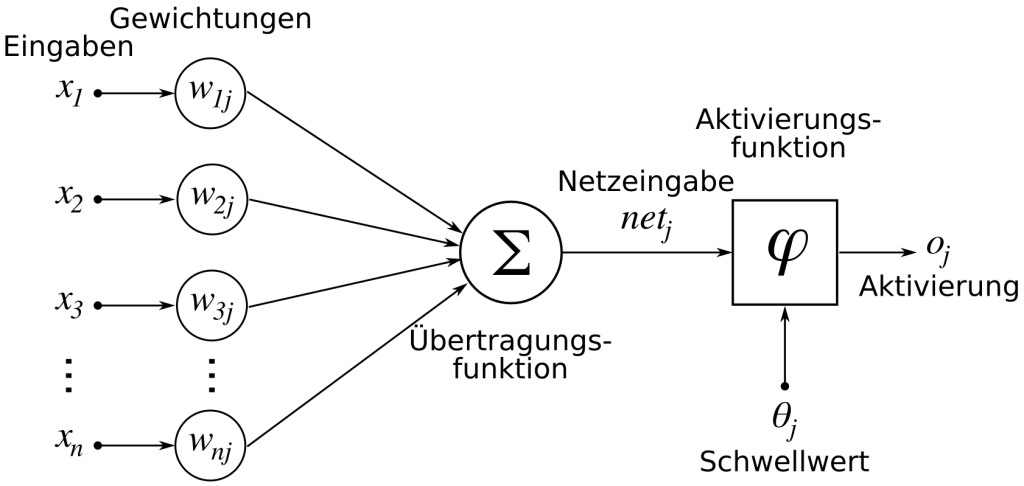

Vereinfacht kann gesagt werden, dass natürliche neuronale Netze aus drei Bestandteilen bestehen: den Synapsen (der Schnittstelle zu anderen Zellen), dem Axon (dem verbindenden Zellausleger) und dem Zellkörper. Wenn die Synapsen Reize empfangen, geben sie dieses Signal an den Zellkörper weiter. Dort entscheidet die Signalstärke, ob das Signal über das Axon weitergeleitet wird. Ähnlich funktionieren auch die KNN. Sie sind so strukturiert, dass sich die einzelnen Signale gewichten und summieren lassen. Praktisch gesehen ‚lernt‘ ein künstliches neuronales Netz hauptsächlich durch die Änderung der Gewichte der eintreffenden Signale.

Aufbau eines künstlichen Neurons

Künstliche Neuronen sind keine Simulationen ihrer biologischen Cousins, sondern mathematische Formeln, die netzwerkartig miteinander verknüpft sind. Diese Formeln können individuell gestaltet werden und auch die Art der Datenverarbeitung kann festgelegt werden, ob bestimmte Werte beispielsweise vor der Verarbeitung des Neurons angepasst werden sollen oder nicht. Das macht diese Netzwerke hochgradig anpassungsfähig, aber ihre Konfiguration dadurch auch sehr komplex.

Wie Hidden Layer in neuronalen Netzen funktionieren

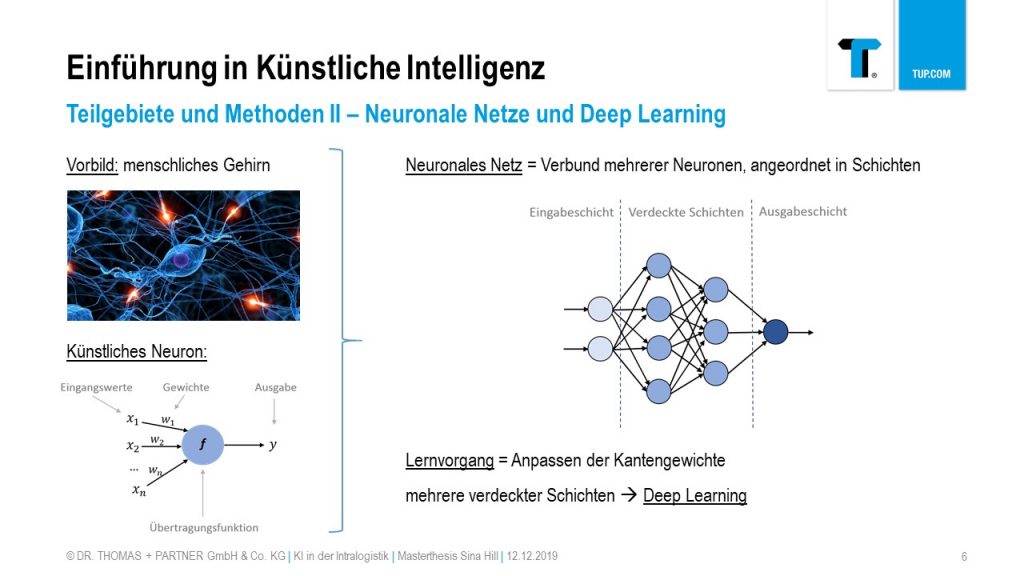

Dabei sind die KNN ähnlich aufgebaut, wie auch die Neuronen im menschlichen Gehirn. Die künstlichen Neuronen werden in hintereinander liegenden Schichten (englisch: Layer) angeordnet und sind miteinander vernetzt. Es gibt eine Eingabe- (Input Layer) und eine Ausgabeschicht (Output Layer) sowie dazwischen befindliche sogenannte ‚verborgene‘ Schichten (Hidden Layer).

Je komplexer eine Aufgabe, desto mehr Hidden Layer sind vonnöten, um diese zu lösen. Wenn es beispielsweise darum geht ein digitales Bild zu analysieren, dann erkennt die erste Schicht zunächst nur die Helligkeitswerte der einzelnen Pixel. In der zweiten Schicht würde dann erkannt werden, dass einige der Pixel zu Kanten verbunden sind. Schicht um Schicht wird somit das Bild analysiert, bis am Ende das gesamte Motiv erkannt wird. Jede Schicht trägt dazu bei, die eintreffenden Daten zu verarbeiten.

Die Anzahl der Schichten beschreibt hierbei die Architektur des Netzes. Daraus ergibt sich eine große Vielfalt an Möglichkeiten. Einige Varianten lassen sich auf der Seite der unabhängigen Forschungseinrichtung ‚The Asimov Institute‘ betrachten. KNN mit vielen verborgenen Schichten nennt man auch Deep Neural Networks, deren Entscheidungswege für einen Menschen auch oft nur bedingt nachvollzogen werden können. Grundsätzlich unterscheidet man zwischen Feedforward-Netzen und Rekurrenten Netzen. Bei den Feedforward-Netzen gibt es nur eine Richtung für den Informationsfluss – von der Input-Schicht über die Hidden-Layer zur Output-Schicht. Im Gegensatz dazu ist es bei den Rekurrenten Netzen möglich, Informationen auch rückwärts fließen zu lassen.

Unerlässlich: Lernregeln und Trainingsdaten

Doch bis ein KNN eine komplexe Aufgabe selbstständig lösen kann, ist es ein langer Weg, denn es muss zunächst trainiert werden. Dafür sind Lernregeln notwendig, die das Netz später automatisch anwenden und anpassen kann. Ebenso werden umfangreiche Trainingsdaten benötigt. Während des Trainings verändern sich die Gewichtungen der Verbindungen zwischen den künstlichen Neuronen, abhängig von den angewandten Lernregeln.

Dabei kann man grundsätzlich zwischen zwei Arten des Lernens unterscheiden: Das überwachte sowie das nicht überwachte Lernen. Beim überwachten Lernen wir das Ergebnis vorgegeben und durch den Menschen überwacht. Dieser gibt dem KNN Rückmeldung, ob das erreichte Ergebnis dem gewünschten Ergebnis entspricht. Anhand des ständigen Vergleichs zwischen Soll- und Ist-Ergebnis lernt das Netz, die Neuronen passend zu verknüpfen. Beim unbeaufsichtigten Lernen wird kein solches Ergebnis vorgegeben und überprüft. Der Lernvorgang basiert alleine auf den Informationen der vielen verschiedenen eingegebenen Muster. Das KNN nimmt die Anpassungen nur anhand der eingegebenen Informationen vor. Die groben Anwendungsszenarien sind, dass unbeaufsichtigtes Lernen auf Situationen mit riesigen, intransparenten Datenmengen angewendet wird, in denen ein Mensch oder eine andere Methode des Maschinenlernens keine Muster mehr entdecken kann: Beim überwachten Lernen ist das zu erreichende Ziel definiert, was häufig mit einem, zumindest oberflächlichen, Verständnis des der Aufgabe zu Grunde liegenden Muster einhergeht, die aber auf Optimierungspotentiale durchleuchtet werden sollen.

Hier ein Beispiel eines neuronalen Netzwerks, das auf der Basis von klar definierten Zielbedingungen lernt, in diesem Fall möglichst bis zum Ende des Levels zu kommen.

Auf der Seite playground.tensorflow.org steht auch ein Interface für ein konfigurierbares Neuronales Netzwerk zu Verfügung. Einen tieferen Einblick geben die AI-Experimente und -Projekte des Googlekonzerns Alphabet.

Künstliche Neuronale Netze in der Intralogistik

Für die Wirtschaftswelt sind KNN in den vergangenen Jahren sehr wichtig geworden. Sie bilden die Grundlage für viele Systeme, die mit Künstlicher Intelligenz (KI) arbeiten. Von der Bild- und Spracherkennung über die Steuerung komplexer Systeme hin zu Frühwarnsystemen und Zeitreihenanalysen sind viele Einsatzmethoden möglich.

Damit eignen sie sich auch besonders für den Einsatz in der Intralogistik. Hier kommen sie unter anderem bei der Mustererkennung zum Einsatz. KNN können beispielsweise Trendartikel erkennen, woraufhin Maßnahmen zu deren optimierter Einlagerung getroffen werden können. Auch im Bereich der Artikelerkennung etwa bei Picking-Prozessen können KNN unterstützen (Pick-by-Vision, Pick-by-Voice etc). Da KNN die Basis für Machine Learning bilden, sorgen sie auch im Bereich der Ablaufoptimierung für Fortschritte. So können sie dabei helfen, Prozesse effizienter zu organisieren und mögliche Engpässe zu vermeiden oder plötzliche Störungen im Betriebsablauf abzufedern.

Fazit

Ob bei der Google-Suche, in Steuerungssystemen von selbstfahrenden Autos oder im Schachcomputer – Künstliche Intelligenz ist aus der modernen Gesellschaft nicht mehr wegzudenken. Dem biologischen Gehirn und seinen Fähigkeiten nachempfunden sind dabei die Künstlichen Neuronalen Netze – ein wichtiger Teilbereich der KI –, in denen hochkomplexe Daten- und Informationsmengen zu zielgenauen Lösungen und Prognosen aufbereitet werden. Die größte Stärke von KNN ist dabei, dass sie auf eine spezielle Aufgabe hin trainiert werden können, die sie fortan selbstständig durchführen. Sind sie erst einmal geschult, können sie diese Aufgabe deutlich besser als Menschen bewältigen, da sie sind, in der Lage große Datenmengen auf einmal zu verarbeiten.